Microsoft hôm thứ ba đã giới thiệu Video Authenticator, một công cụ sử dụng AI để quyết định xem các bức ảnh hay video đã bị can thiệp chỉnh sửa kỹ thuật số hay chưa.

Công cụ này được phát triển và thiết kế để chống lại vấn nạn các tác phẩm của deepfake đang ngày một nhiều hơn. Deepfake là các hình ảnh, video hay âm thanh đã can thiệp bằng AI để chỉnh sửa. Hầu hết các tác phẩm deepfake đều không có thật và mang tính sáng tạo, nhưng nhiều người đã lợi dụng để tạo ra các nội dung phục vụ mục đích xấu. Giải pháp cho việc này chính là một AI được huấn luyện để phát hiện các thay đổi không đúng.

Video Authenticator được giới thiệu là nằm trong chương trình Defending Democracy Program của công ty, chỉ ra nhiều chiến dịch ảnh hưởng từ nước ngoài đã nhắm vào nhiều quốc gia trên thế giới. Những chiến dịch này thường bóp méo và thao túng niềm tin, tư tưởng và một số kích động các cuộc bạo lực. Trong 96 chiến dịch khác nhau được phát hiện để hỗ trợ cho Microsoft, 93% trong số đó đó liên quan tới các nội dung gốc khó phát hiện. Theo Microsoft cho biết, trong thời điểm hiện tại chưa có bất kỳ công cụ nào giúp mọi người giải mã được các nội dung nào là đúng, các nội dung nào là giả thì Video Authenticator sẽ là một công cụ hữu ích.

Tuy nhiên, công cụ này được Microsoft cho biết là không phải giải pháp lâu dài vì công nghệ luôn phát triển và các công cụ AI deepfake sẽ càng phát triển hơn, đây chỉ là một công cụ ngắn hạn dành cho cuộc bầu cử sắp tới tại Mỹ.

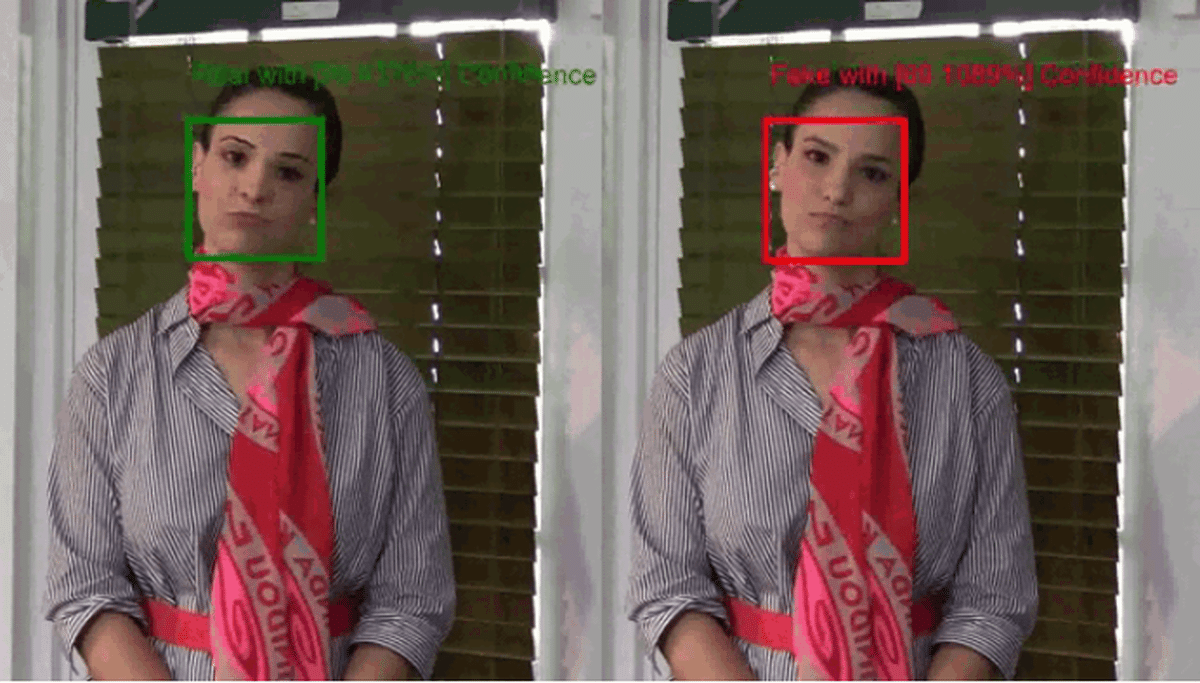

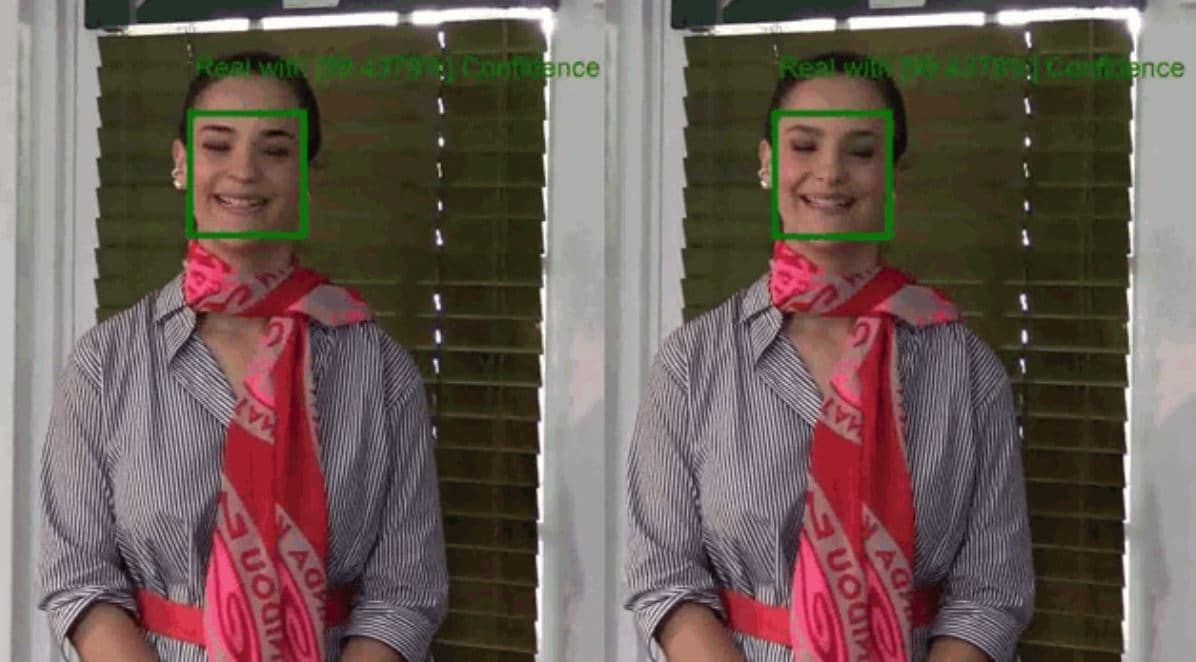

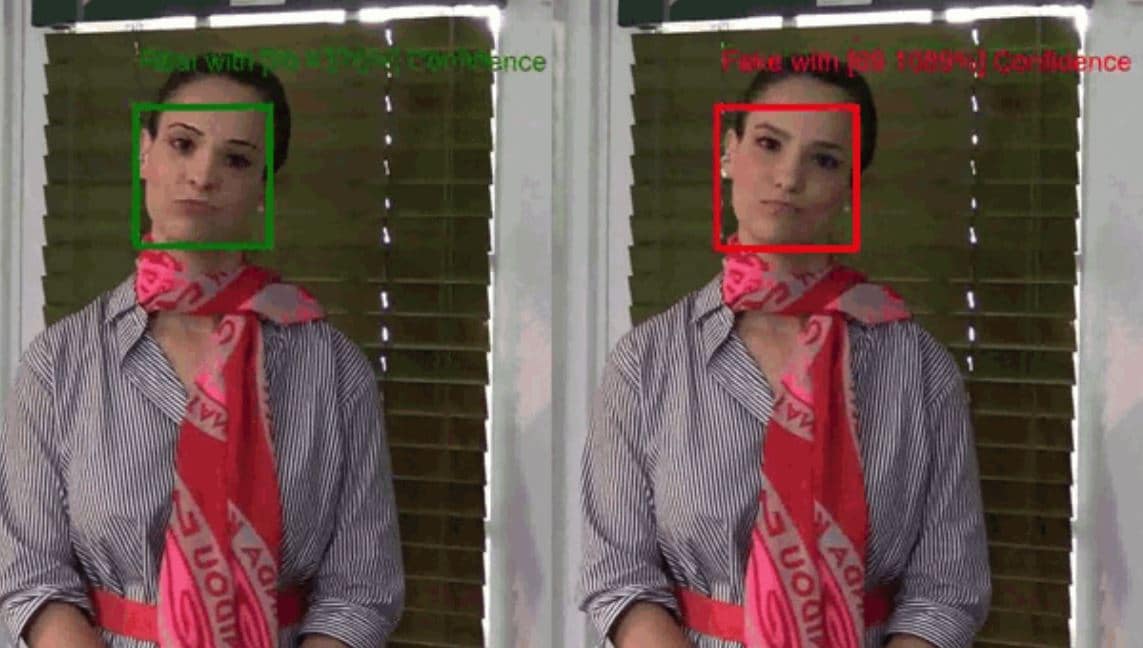

Cơ chế hoạt động của công cụ này là phân tích từng khung hình trong một video hoặc một bức ảnh, sau đó sẽ gắn các điểm gọi là phần trăm bị làm giả để chỉ ra mức độ có khả năng nội dung bị làm giả. Khi sử dụng, công cụ sẽ phân tích trong thời gian thật. Hiện tại Microsoft cho biết công cụ mới chỉ ở giai đoạn đầu và sẽ còn tiếp tục phát triển nó, tuy nhiên công ty không công bố mã nguồn để bảo vệ nó khỏi những kẻ xấu đang phát triển AI deepfake.

Cơ chế hoạt động của công cụ này là phân tích từng khung hình trong một video hoặc một bức ảnh, sau đó sẽ gắn các điểm gọi là phần trăm bị làm giả để chỉ ra mức độ có khả năng nội dung bị làm giả. Khi sử dụng, công cụ sẽ phân tích trong thời gian thật. Hiện tại Microsoft cho biết công cụ mới chỉ ở giai đoạn đầu và sẽ còn tiếp tục phát triển nó, tuy nhiên công ty không công bố mã nguồn để bảo vệ nó khỏi những kẻ xấu đang phát triển AI deepfake.